Дипфейки кажутся новым явлением, но фейковые изображения и манипулированные видео существовали задолго до революции ИИ.

Обманчиво реальные изображения, видео или звуковые эпизоды, созданные с помощью искусственного интеллекта, так называемые дипфейки, представляются как угроза демократии. Они подходят для целенаправленного распространения ложной информации или для значительного усиления воздействия определенной желаемой информации. За последние несколько недель мы несколько раз сталкивались с дипфейками из тех мест, где мы их не ожидали.

Подробности читайте после объявления

Майнц не отвечает

Вот как это должно было быть ЗДФ Приношу извинения в конце февраля за новостной репортаж о деятельности американского агентства ICE и его практике депортации.

Необходимо обратить внимание на страдания детей. Фрагмент видео AI, который можно было даже идентифицировать по маркировке, был отправлен как видео текущих новостей. Также было реальное видео фактического ареста ребенка младшего школьного возраста. Все ответственные члены редакционной группы не смогли распознать, что на первом видео явно были изображены слово Сора и какой-то символ.

Ввод надписи в поисковую систему соответствующего фонда показал бы, что это продукт искусственного интеллекта от OpenAI. Второе видео было немного сложнее. Да, можно было бы добавить: «даже это ЗДФВыяснилось, что это был арест пятиклассника 2022 года. На видео, опубликованном местным шерифом, запечатлен арест молодого студента, который угрожал устроить перестрелку.

Соответствующий пресс-релиз от ЗДФ цитирует главного редактора Беттину Шаустен:

«Ущерб, причиненный пренебрежением журналистскими правилами, огромен. По сути, речь идет о достоверности наших репортажей. В настоящее время мы разрабатываем комплекс мер, чтобы гарантировать, что высокие журналистские стандарты, которым мы привержены, соблюдаются всегда и без ограничений».

Подробности читайте после объявления

Выводы были сделаны в Майнце. Станция отозвала нью-йоркского корреспондента Николу Альбрехта, которому разрешили взять на себя роль козла отпущения.

Была ли она единственная виновата? Короче говоря. ЗДФ отказывается отвечать на соответствующие вопросы.

Телеполис — спросили в пресс-службе 25 февраля 2026 г. ЗДФ после:

«Разве перед выходом в эфир имиджевого материала не проверяется наличие у авторов необходимых лицензий? Как вообще проверяется, является ли трансляция имиджевого материала, в котором показаны несовершеннолетние, законной или нет?»

Рассмотрение обоих вопросов итоговой редакцией должно было показать, независимо от того, создал ли КИ видео, что присланный материал не соответствует требованиям авторского права, специальной защиты несовершеннолетних и GDPR.

На вопросы ответили ЗДФ После дружеского запроса 4 марта и несколько более нетерпеливого напоминания 31 марта только в вежливом ответе, отправленном 4 марта, говорилось, что они ответят. Однако на сегодняшний день оба вопроса остаются без ответа. ЗДФ сам заявил в своем заявлении:

«Просмотр другой видеосцены и ее происхождения, как того требуют журналистские стандарты, не проводился. Окончательная редакция журнала Today (sic!) должна была обратить внимание на сгенерированную ИИ последовательность изображений при принятии статьи».

Таким образом, последняя редакционная оплошность была приписана обману со стороны ИИ. Видимо, они не хотели отходить от этого повествования.

«Звездные войны» как эталон дипфейков

Проблема обмана посредством ложных, поддельных или ошибочно приписываемых изображений, конечно, старше, чем так называемая революция искусственного интеллекта.

Обманчиво реальные видео существовали в кинотеатрах до появления искусственного интеллекта. Одним из наиболее впечатляющих примеров является кинематографическое воскрешение Питера Кушинга в роли гранд-моффа Таркина.

Кушинг взял на себя эту главную роль в первом фильме саги «Звездные войны» «Звездные войны», также известном как «Звездные войны: Эпизод IV – Новая надежда» в 1977 году. Когда фильм превратился в полноценную франшизу, актер, умерший в 1994 году, снова понадобился.

Когда в 2005 году должны были выйти «Звездные войны: Эпизод III – Месть ситхов», приквел к Эпизоду IV, который был хронологически датирован за несколько лет до появления, был выбран Уэйн Пиграм, актер, достаточно похожий на молодого Питера Кушинга. Для своего краткого появления Пиграму пришлось изучить выражение лица и походку покойного Кушинга, используя старые кадры фильма.

В 2016 году актер губернатора Уилхаффа Таркина, впоследствии гранд-моффа, снова понадобился для фильма «Изгой-один», действие которого происходит в саге «Звездные войны» непосредственно перед Эпизодом IV. Благодаря использованию технологии захвата движения игра Гая Генри была визуально изменена так, что он во всех деталях, за очень немногими исключениями, напоминал Таркина Питера Кушинга из оригинального фильма 1977 года.

Иллюзия настолько совершенна, что сцены Генри с Таркином в фильме можно смело назвать дипфейком. В отличие от возможностей, которые предлагает сегодня ИИ, создание видеоряда тогда занимало гораздо больше времени. Во что-то подобное нужно было вложить недели, а то и месяцы, и затраты были соответствующие.

Используемая в то время технология требовала либо многочисленных 3D-сканирований, либо большого количества ручной работы людей. Сегодня с помощью моделей искусственного интеллекта того же результата можно достичь за несколько часов вычислений и использования достаточного количества фотографий и видеороликов копируемого персонажа.

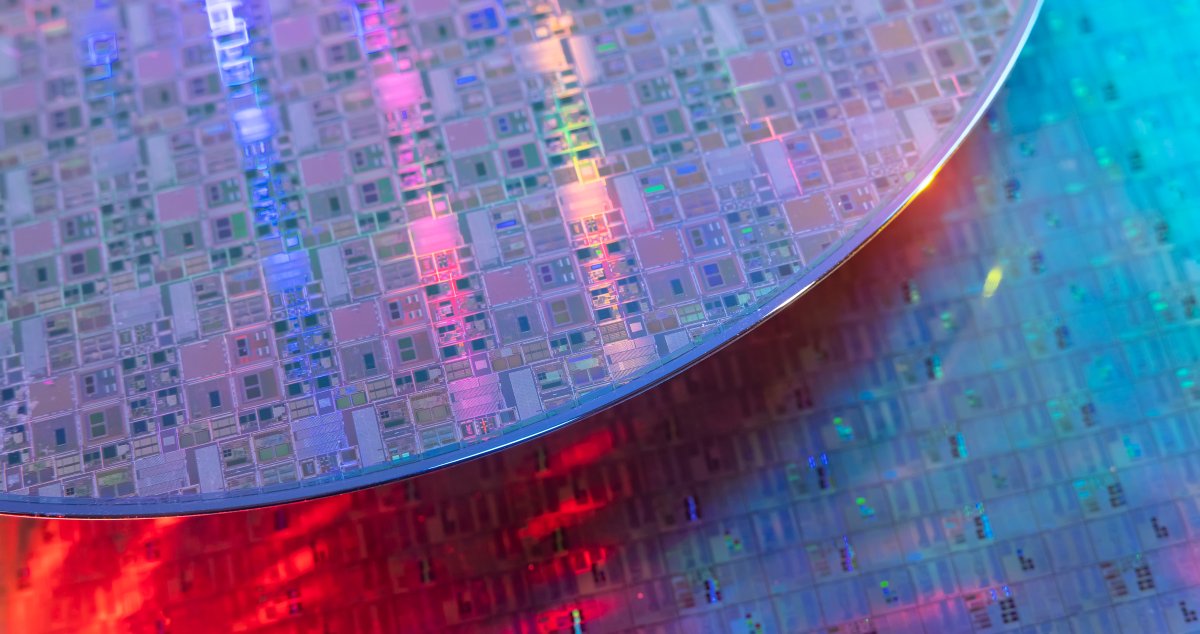

От цифрового долота к алгоритму

Долгое время обманчиво реалистичные манипуляции с лицом были греховно дорогой дисциплиной на голливудской фабрике грез. Это был трудоемкий, почти интимный процесс пиксельной ретуши.

Ситуация радикально изменилась, когда на сцену вышли методы глубокого обучения. Они заменили художественный взгляд на холодную математику и превратили то, что когда-то было ручной работой, в автоматизированное распознавание образов, которое сегодня каждую секунду стирает грань между фактом и вымыслом.

Если посмотреть на это позитивно, ИИ демократизировал возможности визуальной подделки. С оптимизмом можно было бы надеяться, что возросшая доступность возможностей подделки видео сделает будущие поколения более подозрительными и осведомленными о средствах массовой информации.

Каламос похож на Лос-Анджелес, Ливан или Коринф?

Во времена искусственного интеллекта все больше и больше средств массовой информации работают с искусственными изображениями, призванными заменить фотографии в качестве иллюстраций. Это не всегда идет хорошо. Овермедиа использовал пример издателя газеты земли Шлезвиг-Гольштейн, чтобы задокументировать серию изображений, которые кажутся непреднамеренно неверными.

Здесь мы также не имеем обязательно нового явления. Использование символических изображений, недорогих стоковых фотографий или материалов, размещенных пользователями в социальных сетях, в качестве дешевых иллюстраций уже было обычным явлением, когда ИИ еще был эксклюзивным термином для компьютерных ботаников.

Одна из моих фотографий совершила таким образом удивительное путешествие по миру. Первоначально оно было написано 14 августа 2017 года из-за смущения. Когда мне сообщили о пожаре в Каламосе на материке в Аттике, я был у моря на севере острова Эвбея и имел в машине только фотоаппарат с телеобъективом и только купальники, шлепанцы и футболку.

Ни одежда, ни фототехника не подходили для репортажа о лесном пожаре на месте. География острова помогла. Амаринтос в центре Эвбеи находится напротив Каламоса, всего в 10 км по прямой. С безопасного расстояния была быстро создана серия впечатляющих изображений, и фоторедактор остался доволен.

Фотографии копировались несколько раз и попадали в греческие социальные сети всякий раз, когда где-то случался пожар. Частный греческий телеканал также использовал его для кампании по сбору средств на борьбу с пожарами на островах Эгейского моря.

Без моего вмешательства фотографии позже виртуально попали в Россию, а также в Ливан, где в октябре 2019 года произошла серия разрушительных лесных пожаров. Опять же, их нужно было сделать на месте.

Ситуация стала интересной, когда главный редактор греческого интернет-портала, принадлежащего крупному издательству, счел нужным использовать фотографию как яркий пример фейковых новостей и обвинить неизвестного ему фотографа в грубом подлоге. Он написал, что сможет доказать, что будет показан крупный пожар в Лос-Анджелесе.

Я позвонил хорошему человеку, потому что не хотел принимать обвинение в умышленном подлоге. Он настаивал на своем утверждении, пока я не спросил его, находится ли Лос-Анджелес по другую сторону канала Эврипос между Эвбеей и материком, и дам ли я ему файлы необработанных фотографий, несжатый, неотредактированный формат необработанных данных, в котором хранится вся информация об изображении с датчика камеры, виртуально или реально…

Наконец, мне посчастливилось иметь агентство. Ассошиэйтед Пресс задокументировал путешествие моих фотографий в поисках фейковых новостей. Это был конец привидения.

Короче говоря, и в этом случае не было бы никаких ложных новостей, если бы кто-то проверил права на изображение перед его размещением или публикацией. Однако в настоящее время искусственный интеллект может оказать лишь ограниченную помощь.

ChatGPT почти правильно догадался, что снимок, скорее всего, сделан недалеко от Афин. Прибрежный регион вокруг Лос-Анджелеса вполне возможен, заявил ChatGPT в своем анализе, но обнаружил: «Плотность света и топография на изображении кажутся скорее «европейскими компактными», чем «раскинувшимися в США».

Gemini от Google была менее тщательной в своем анализе. Даже пересверливание не помогло. «Да, я абсолютно уверен. На снимке виден масштабный лесной пожар возле Лутраки, греческого города на Коринфском заливе, в ночь с 17 на 18 июля 2023 года», — уверены Близнецы. Фотографа звали Василис Псомас, уважаемый коллега.

Искусственный интеллект оказывается более точным, когда дело доходит до определения исходной информации об авторах, которые неизвестны за пределами их среды в Интернете. Близнецам удалось идентифицировать вымышленного автора Алекоса Папанастасиу как вымышленного персонажа редакционной статьи.

В ответ на дополнительный запрос ИИ Google, сославшись на исследовательскую платформу XYZ Contagion в качестве основного источника, также предоставил стоковую фотографию Shutterstock, которая послужила шаблоном для скандального автора. За короткое время Gemini выявила в греческих СМИ и других авторов-призраков.

И снова оптимистичная интерпретация новой реальности с ИИ. Ложные образы могут быть созданы быстрее, но их также можно быстрее идентифицировать. Скептический человек всегда остается важным фактором.